Depth Completion论文三篇

Depth Completion

I. Intros

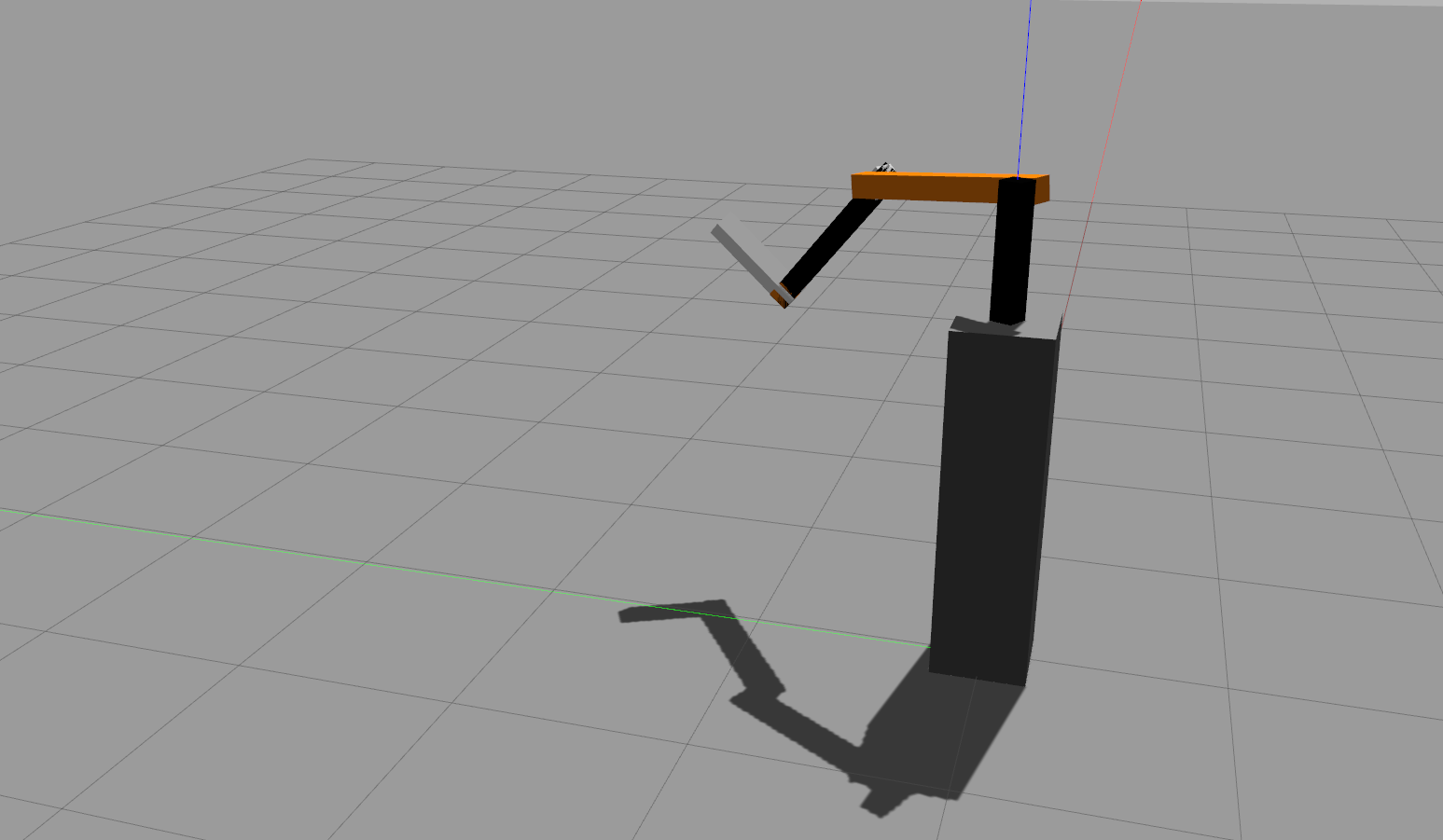

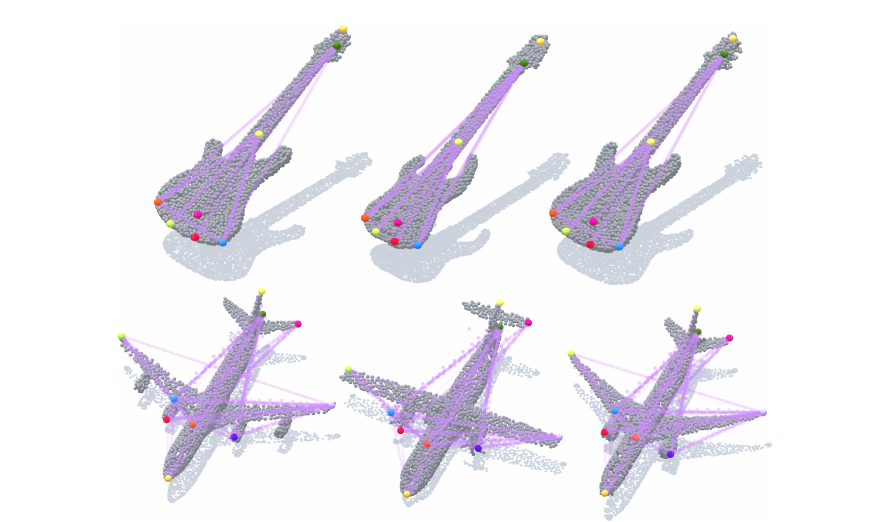

深度补全中存在多模态数据融合的问题:单目RGB图像直接进行深度估计比较困难(直接深度估计,个人感觉只能凭借常识和先验知识),而如果同时存在稀疏激光点云(散步在稠密的图像上),可以通过“传播的思想”将一些位置的深度传播出去。在返乡的高铁上没事干(事实上由于河南大雪以及湖北大雨,高铁变成了低铁,时间+2h),看了五篇论文,本文简要分析了其中三篇关于 guided深度补全的文章:

- ICCV 2019: Xu, Yan, et al. "Depth completion from sparse lidar data with depth-normal constraints." Proceedings of the IEEE/CVF International Conference on Computer Vision. 2019.

- ICRA 2020 (可能写得不行 才6引): Hu, Mu, et al. "Towards Precise and Efficient Image Guided Depth Completion." arXiv e-prints (2021): arXiv-2103.

- AAAI 2020: Cheng, Xinjing, et al. "Cspn++: Learning context and resource aware convolutional spatial propagation networks for depth completion." Proceedings of the AAAI Conference on Artificial Intelligence. Vol. 34. No. 07. 2020.

本文可能写得很烂,笔者在看这三篇论文以及写博客时,由于返乡安排太紧,只睡了3.25小时。